Un lloc ombrívol a internet amaga milers de vídeos pornogràfics on les protagonistes són famoses com Taylor Swift o Mila Kunis. Tot i que en les imatges apareixen els seus rostres, el cos no és el seu. Com a nines, van ser creades amb intel·ligència artificial, amb un "programari" que va reemplaçar la cara d'una actriu porno per la de les artistes.

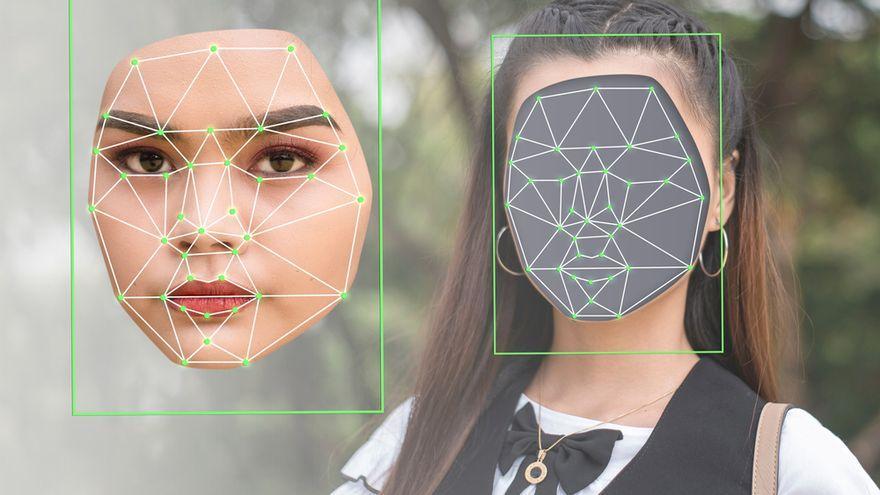

Es tracta de "deepfakes", creacions digitals fetes amb algorismes que aprenen a base de la repetició i que després de codificar desenes d'imatges de rostres des de diferents angles poden substituir la cara i la veu d'una persona per la d'una altra.

No tenen per què ser perniciosos, s'usen també en la indústria del cinema o en la publicitat, però la companyia Sensity AI estima que entre el 90% i el 95% de tots els "deepfakes" en línia són pornografia i al voltant del 90% inclou a dones.

Silenciar a dones líders

En aquest pati posterior virtual, la gran majoria d'usuaris anònims utilitza les cares d'actrius o cantants famoses. Així i tot, les víctimes també són polítiques o activistes.

Efe va rebre al novembre un "deepfake" de l'activista Greta Thunberg que mostrava a la jove de 18 anys gesticulant i ballant nua. El vídeo estava circulant al Brasil per WhatsApp i anava acompanyat d'un missatge que l'acusava de "estar provant noves tàctiques en contra del canvi climàtic".

Amb una cerca en internet, Efe va trobar el vídeo de l'actriu original a qui havien reemplaçat la cara per la de Thunberg.

Catalina Moreno, de Fundació Karisma, organització colombiana que treballa en la promoció dels drets humans en el món digital, assenyala que aquest tipus de "deepfakes" busquen "silenciar, evitar que hi hagi dones visibles i en debats públics".

En el cas de Thunberg, afegeix l'experta, el "deepfake" vol "qüestionar si el seu activisme en medi ambient és creïble tenint en compte que hi ha un vídeo circulant d'ella nua" i "deixar el seu discurs en un segon pla, llevar-li interès a la lluita que està avançant".

La periodista de recerca índia Rana Ayyub explica en un article com, després de criticar a l'Índia per una violació a Caixmir d'una nena de 8 anys, va començar a circular un "deepfake" pornogràfic en el qual apareixia el seu rostre i pel qual va sofrir ciberassetjament a les xarxes.

Les conseqüències a la llarga, afegeix, van ser problemes mentals i autocensura.

L'ONU es va pronunciar sobre el cas demanant-li al Govern indi que la protegís del ciberassetjament, però no va haver-hi cap repercussió per als autors.

Els vídeos falsos a més poden posar en risc la vida d'homes en països on l'homosexualitat està criminalitzada, en alguns amb pena de mort.

Sobretot, a l'ésser una tecnologia que en els últims anys ha agafat força i és possible crear-la amb una aplicació en el mòbil.

A pesar que els "deepfakes" generats amb programes gratuïts no són perfectes, per a desprestigiar a una dona n'hi ha prou que siguin versemblants.

Utilitzar com a arma la sexualitat de les dones no és nou. Un informe de la violència política en xarxes socials a l'Equador recull el testimoni d'una política a la qual van anunciar com a prostituta en una pàgina web i van adjuntar el seu telèfon. En l'anunci havien utilitzat la seva foto de campanya.

A l'abast de qualsevol

Per a generar "deepfakes" es necessiten grans quantitats d'imatges i vídeos des de diferents angles, per això fins ara era difícil utilitzar-les en contra de dones anònimes. Així i tot, ja existeixen aplicacions que analitzen fotografies de dones i amb intel·ligència artificial les despullen en pocs minuts.

Sensity AI va trobar el 2020 un chatbot de Telegram que havia despullat almenys 100.000 dones. Per part seva, un estudi impulsat pel Parlament europeu per a abordar els "deepfakes" en la política europea assenyala que les aplicacions estan dissenyades amb biaixos de gènere.

La recerca apunta que no hi ha regulació en la majoria de països del món i recull els exemples dels estats dels EUA de Virgínia, Texas i Califòrnia, els primers en aquest país a impulsar lleis sobre "deepfakes".

Cardona insisteix en la importància que les grans empreses tecnològiques es comprometin i detinguin el flux d'aquests vídeos a les seves plataformes. A pesar que tant la web pornogràfica PornHub i Twitter prohibissin els "deepfakes" porno, EFE Verifica va comprovar que cada dia es pengen centenars de vídeos en aquestes plataformes.

Algunes empreses han desenvolupat programes per a identificar "deepfakes", però no estan a l'abast de l'usuari. Per això, és important conèixer alguns consells per a determinar si es troba davant d'un "deepfake", com fixar-se en si les gesticulacions o la veu sofreixen retards, si el color de la pell entre la cara i el cos coincideixen, o si la font de la qual provenen les imatges és de confiança i pública.